Durante varios días de este mes, la capa de hielo de la superficie de Groenlandia se derritió en un área mayor que en cualquier momento en más de 30 años de observaciones satelitales. Casi toda la cubierta de hielo de Groenlandia, desde sus delgados, bajos bordes costeros hasta su centro de dos kilómetros de espesor, experimentó cierto grado de derretimiento en su superficie, de acuerdo con las mediciones de tres satélites independientes analizadas por la NASA y científicos de universidad.

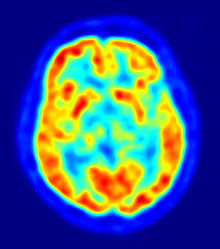

En promedio en el verano, cerca de la mitad de la superficie de la capa de hielo de Groenlandia se derrite de forma natural. En altas elevaciones, la mayor parte de esa agua de deshielo rápido vuelve a congelarse en su lugar. Cerca de la costa, parte del agua de deshielo es retenida por la capa de hielo y el resto se pierde en el océano. Pero este año la extensión del hielo derritiendose en la superficie o cerca de ella ha aumentado notablemente. De acuerdo con los datos satelitales, se estima que el 97% de la superficie de la capa de hielo se descongeló en algún momento a mediados de julio.

Los investigadores aún no han determinado si este evento de extenso deshielo afectará el volumen global de pérdida de hielo este verano y contribuirá a la elevación del nivel del mar.

“La capa de hielo de Groenlandia es una extensa zona con una variada historia de cambio. Este evento, junto con otros fenómenos naturales pero poco frecuentes, como el gran evento de desprendimiento de hielo la semana pasada en el Glaciar Petermann, son parte de una historia compleja”, dijo Tom Wagner , director del programa de la criosfera de la NASA en Washington. “Las observaciones por satélite están ayudando a entender cómo eventos como estos pueden relacionarse unos con otros, así como con el sistema climático más amplio.”

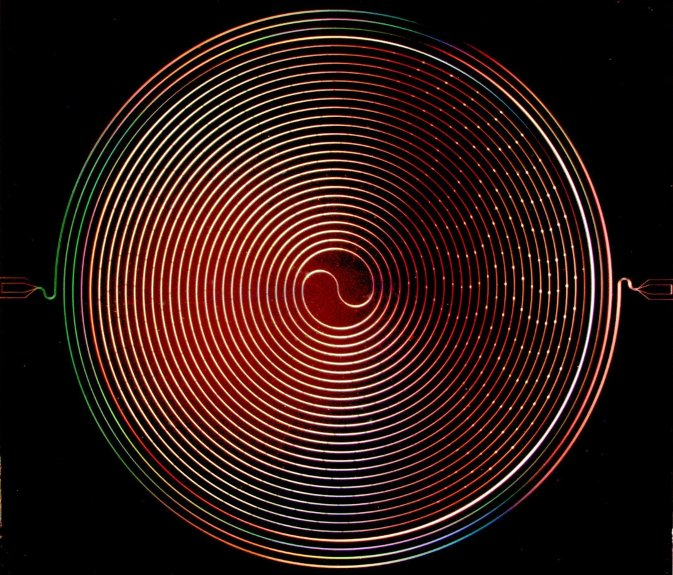

Son Nghiem, del Laboratorio de Propulsión a Chorro de la NASA en Pasadena, California, estaba analizando datos de radar del satélite Oceansat-2 de la Indian Space Research Organisation (ISRO) la semana pasada cuando se dio cuenta de que la mayor parte de Groenlandia pareció haber sufrido derretimiento de la superficie el 12 de julio. Nghiem dijo: “Esto fue tan extraordinario que al principio cuestioné el resultado: ¿fue esto real o se debió a un error de datos?”

Nghiem consultó con Dorothy Hall en el Centro Goddard de Vuelo Espacial de la NASA en Greenbelt, Maryland. Hall estudia la temperatura de la superficie de Groenlandia usando el Espectroradiometro de Imágenes de resolución Moderada (MODIS) a bordo de los satélites Terra y Aqua de la NASA. Ella confirmó que MODIS mostró temperaturas inusualmente altas y que el deshielo era abundante sobre la superficie de la capa de hielo.

Thomas Mote, un climatólogo de la Universidad de Georgia, Athens, Georgia, y Marco Tedesco, de la Universidad de la Ciudad de Nueva York también confirmó el deshielo visto por Oceansat-2 y MODIS con los datos de satélite de microondas pasivas del Special Sensor Microwave Imager/Sounder en un satélite meteorológico de la Fuerza Aérea de los Estados Unidos.

El deshielo se extendió rápidamente. Mapas del derretimiento derivados de los tres satélites mostraron que el 8 de julio, alrededor del 40% de la superficie de la capa de hielo se había derretido. Para el 12 de julio, el 97% se había derretido.

Este evento de derretimiento extremo coincidió con un frente inusualmente fuerte de aire caliente, o una cúpula de calor, sobre Groenlandia. El frente era uno de una serie que ha dominado el clima de Groenlandia desde finales de mayo. “Cada frente sucesivo ha sido más fuerte que el anterior”, dijo Mote. Esta última cúpula de calor comenzó a moverse sobre Groenlandia el 8 de julio, y luego se estacionó sobre la capa de hielo unos tres días después. Por el 16 de julio, había comenzado a disiparse.

Incluso el área alrededor de la Estación Summit en el centro de Groenlandia, que a 2 kilómetros sobre el nivel del mar está cerca del punto más alto de la capa de hielo, mostró signos de deshielo. Tal derretimiento pronunciado en Summit y en toda la capa de hielo no se ha producido desde 1889, de acuerdo con los núcleos de hielo analizados por Kaitlin Keegan en el Dartmouth College en Hanover, New Hampshire. Una estación meteorológica de la Administración Nacional Oceánica y Atmosférica (NOAA) en Summit confirmó que las temperaturas del aire rondaron por encima o a un grado del congelamiento por varias horas el 11-12 de julio.

“Los núcleos de hielo de Summit muestran que los eventos de deshielo de este tipo ocurren aproximadamente una vez cada 150 años en promedio. Con el último acontecimiento en el año 1889, este evento esta justo a tiempo”, dice Lora Koenig, un glaciólogo del Goddard y miembro del equipo de investigación que analiza los datos obtenidos por satélite. “Pero si seguimos observando acontecimientos de derretimiento de este tipo en los próximos años, será preocupante”.

El descubrimiento de Nghiem mientras analizaba datos del Oceansat-2 era el tipo de beneficio que la NASA y la ISRO tenían la esperanza de estimular cuando firmaron un acuerdo en marzo de 2012 para cooperar en Oceansat-2 con el intercambio de datos.

Fuente

http://www.nasa.gov/ (en inglés)